যেহেতু অ্যাপল ঘোষণা করেছে আইওএস, আইপ্যাডওএস এবং ম্যাকওএস -এর জন্য শিশু যৌন নির্যাতনের উপাদান সনাক্তকরণ এই মাসের শুরুর দিকে, অনেক বিতর্ক হয়েছিল। শুধু নিরাপত্তা বিশেষজ্ঞদের মধ্যেই নয়, এমনকি অ্যাপলের নিজস্ব কর্মীদের মধ্যেও যারা অ্যাপলকে এটি বাস্তবায়ন না করতে বলেছে।

এই ব্যবস্থার বাস্তবায়নের জন্য সর্বশেষ অস্থিরতার সাথে যোগ দেওয়ার চেয়ে বেশি 90 নাগরিক অধিকার গোষ্ঠী। তারা অ্যাপলকে একটি খোলা চিঠি লিখেছে, যাতে এটি তার CSAM (শিশু যৌন নির্যাতন উপাদান) পরিকল্পনার পিছনে ফিরে যেতে বলে। কারণ তারা ইঙ্গিত দেয় যে এই সিস্টেমটি অন্যান্য উদ্দেশ্যে ব্যবহার করা যেতে পারে।

CSAM কি?

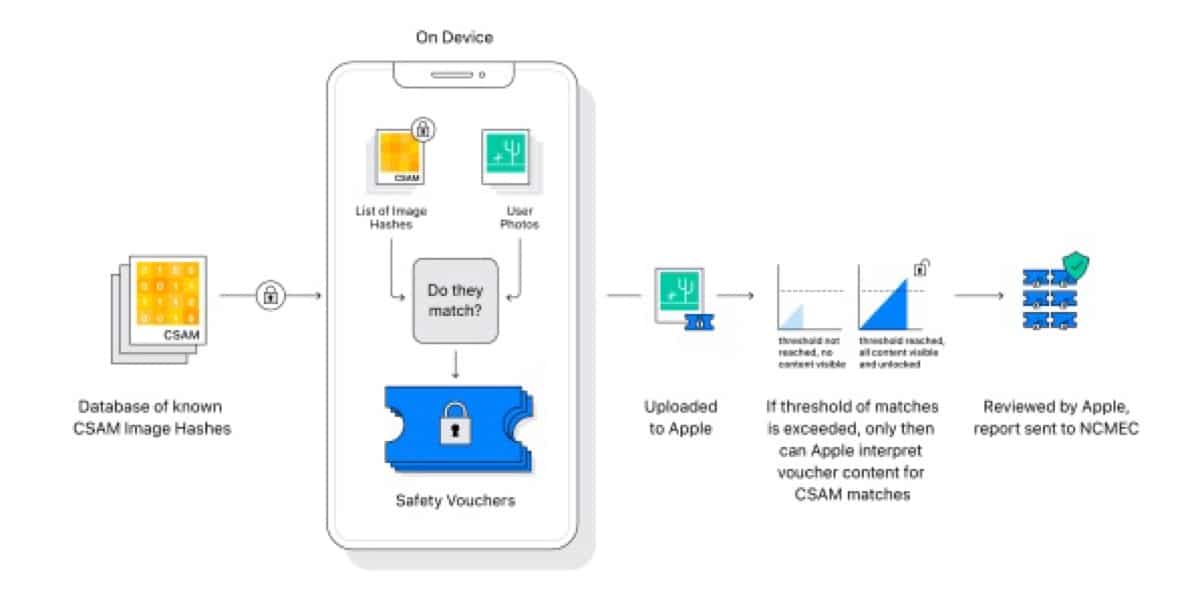

CSAM, শিশু যৌন নির্যাতন উপাদান হিসেবে অনুবাদ করা হয়, একটি শিশু পর্নোগ্রাফির বিষয়বস্তু সহ ফটোগ্রাফের ক্যাটালগ, পরিচিত, প্রস্তুত এবং আপডেট পর্যায়ক্রমে বিভিন্ন সমিতি দ্বারা এবং যার বিষয়বস্তু ন্যাশনাল সেন্টার ফর মিসিং অ্যান্ড এক্সপ্লয়েটেড চিলড্রেন (এনসিএমইসি) দ্বারা নিয়ন্ত্রিত হয়।

এই ডাটাবেসে সংরক্ষিত প্রতিটি ফটোগ্রাফের একটি অনন্য ডিজিটাল স্বাক্ষর, একটি ডিজিটাল স্বাক্ষর যা এটি iCloud ব্যবহারকারীদের অ্যাকাউন্টে সংরক্ষিত ফটোগুলির ছবির সাথে তুলনা করা হবে। যদি কোনো ম্যাচ ধরা পড়ে, ব্যবহারকারীর অ্যাকাউন্টে প্রবেশ বন্ধ করে দেওয়া হবে এবং কর্তৃপক্ষকে জানানো হবে।

গুগল, ড্রপবক্স এবং মাইক্রোসফট কিছু সময়ের জন্য ব্যবহারকারীর অ্যাকাউন্টের জন্য এই ইমেজ ট্র্যাকিং সিস্টেম ব্যবহার করছে, কিন্তু অ্যাপল এক ধাপ এগিয়ে গেছে এবং NeuralHash নামে একটি নতুন সিস্টেম তৈরি করেছে, একটি সিস্টেম যা ব্যবহারকারীর এনক্রিপ্টেড ক্লাউড বিশ্লেষণ করে, তত্ত্বগতভাবে, এই ধরনের ছবি খুঁজছে এবং যা অ্যাপল নিজেও অ্যাক্সেস করতে পারে না।

নাগরিক অধিকার সংস্থা থেকে বিরক্ত

entre এই চিঠির কিছু স্বাক্ষরকারী আমেরিকান সিভিল লিবার্টিজ ইউনিয়ন, কানাডিয়ান সিভিল লিবার্টিজ অ্যাসোসিয়েশন, অস্ট্রেলিয়ান সংস্থা ডিজিটাল রাইটস ওয়াচ, ব্রিটিশ লিবার্টি, প্রাইভেসি ইন্টারন্যাশনাল ...

চিঠিটি নিউরাল হ্যাশের ক্ষমতা তুলে ধরে শুরু করে, এই বলে যে:

যদিও শিশুদের সুরক্ষা এবং শিশু যৌন নির্যাতন উপাদান (CSAM) এর বিস্তার কমানোর জন্য সক্ষমতা তৈরি করা হয়েছে, আমরা উদ্বিগ্ন যে এটি সুরক্ষিত অভিব্যক্তি সেন্সর করতে, বিশ্বজুড়ে মানুষের গোপনীয়তা ও নিরাপত্তাকে হুমকির মুখে ফেলতে এবং অনেক শিশুর জন্য বিপর্যয়কর পরিণতি ঘটাতে পারে ।

একবার এই ক্ষমতা অ্যাপল পণ্যের মধ্যে অন্তর্ভুক্ত করা হলে, কোম্পানি এবং তার প্রতিযোগীরা বিপুল চাপের মুখোমুখি হবে - এবং সম্ভাব্য আইনি প্রয়োজনীয়তা - বিশ্বব্যাপী সরকার থেকে কেবল CSAM- এর জন্য নয়, অন্যান্য ছবিগুলিও যা সরকার সন্দেহজনক মনে করে স্ক্যান করার জন্য।

সেই ছবিগুলো হতে পারে মানবাধিকার লঙ্ঘন, রাজনৈতিক প্রতিবাদ, যে ছবিগুলোকে কোম্পানিগুলো 'সন্ত্রাসী' বা হিংসাত্মক উগ্রবাদী বিষয়বস্তু হিসেবে চিহ্নিত করেছে, অথবা এমনকি রাজনীতিবিদদেরও অযৌক্তিক ছবি যারা কোম্পানিকে তাদের স্ক্যান করার জন্য চাপ দেবে।

এই organizations০ টি সংগঠন দাবি করে যে, ছবি অনুসন্ধান ডিভাইসে সংরক্ষিত ছবিগুলিতে বাড়ানো যেতে পারেশুধু আইক্লাউডে সংরক্ষিত নয়, তাই অ্যাপল বিশ্বব্যাপী সেন্সরশিপ, নজরদারি এবং নিপীড়নের ভিত্তি তৈরি করতে পারে।

এটা বলার অপেক্ষা রাখে না যে যখন একটি সরকার অ্যাপলকে চীন বা রাশিয়ার মতো ব্যবহারকারীদের বিষয়বস্তুতে অ্যাক্সেস দেওয়ার জন্য অনুরোধ করে, আপেল মাথা নত করে এবং আপনার চাহিদা পূরণ করে। কে আমাদের আশ্বাস দেয় যে অ্যাপল অন্যান্য দেশের সাথে একই নীতি অনুসরণ করবে না?

চিঠিতে বলা হয়েছে যে এই ব্যবস্থা শিশুদের ঝুঁকিতে ফেলবে:

অ্যাপল যে সিস্টেমটি ডেভেলপ করেছে তা ধরে নেয় যে "পিতামাতা" এবং "শিশু" অ্যাকাউন্টগুলি প্রকৃতপক্ষে একজন প্রাপ্তবয়স্ক ব্যক্তির অন্তর্ভুক্ত যারা একজন সন্তানের পিতা -মাতা এবং এই ব্যক্তিদের একটি সুস্থ সম্পর্ক রয়েছে।

এই সবসময় তা হয় না; একজন আপত্তিকর প্রাপ্তবয়স্ক অ্যাকাউন্টের আয়োজক হতে পারে, এবং বাবা-মাকে অবহিত করার পরিণতি শিশুর নিরাপত্তা এবং কল্যাণকে হুমকির মুখে ফেলতে পারে। এলজিবিটিকিউ + সহানুভূতিহীন পিতামাতার পারিবারিক অ্যাকাউন্টের যুবকরা বিশেষত ঝুঁকিতে রয়েছে

চিঠিটি শেষ করে বলা হয়েছে যে অ্যাপলের শিশু নির্যাতন কমাতে সচেষ্ট হওয়া সত্ত্বেও সংস্থাটি গোপনীয়তা নীতিতে দৃ remain় থাকতে হবে যা তিনি সাম্প্রতিক বছরগুলিতে তৈরি করেছেন।

আমরা শিশুদের সুরক্ষার প্রচেষ্টাকে সমর্থন করি এবং CSAM এর বিস্তারের তীব্র বিরোধিতা করি। কিন্তু অ্যাপল যে পরিবর্তনগুলি ঘোষণা করেছে তা এখন এবং ভবিষ্যতে উভয়ই শিশুদের এবং অন্যান্য ব্যবহারকারীদের ঝুঁকিতে ফেলেছে। আমরা অ্যাপলকে সেই পরিবর্তনগুলি পরিত্যাগ করতে এবং কোম্পানির ব্যবহারকারীদের এন্ড-টু-এন্ড এনক্রিপশনের সুরক্ষার প্রতিশ্রুতি পুনরায় নিশ্চিত করার আহ্বান জানাই। আমরা অ্যাপলকে নাগরিক সমাজ গোষ্ঠী এবং দুর্বল সম্প্রদায়ের সাথে আরও নিয়মিত পরামর্শ করার আহ্বান জানাই যা তার পণ্য এবং পরিষেবার পরিবর্তনের কারণে অসমভাবে প্রভাবিত হতে পারে।

পোস্ট

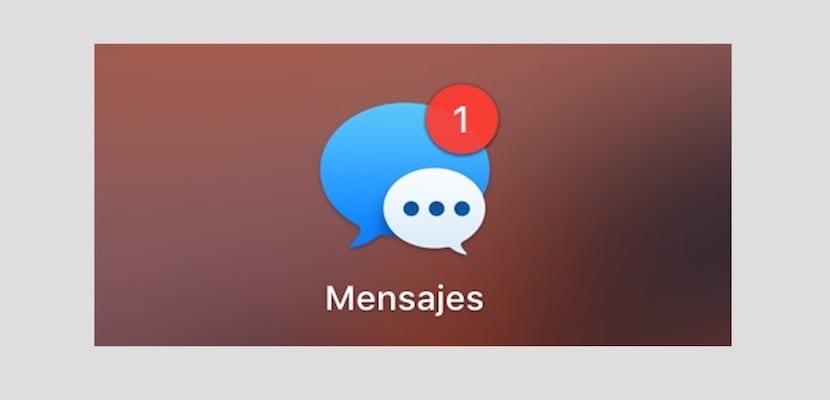

অ্যাপল এই নতুন ফিচারটি চালু করবে MacOS Monterey, iOS 15, এবং iPadOS 15 রিলিজের সাথে, একটি ফাংশন যা একটি সিস্টেমের সাথে থাকে যা বার্তা অ্যাপ্লিকেশনের মাধ্যমে শিশু যৌন সামগ্রীর প্রচার সনাক্ত করবে এবং যদি নাবালক যৌন নিহিত হিসাবে শ্রেণীবদ্ধ ছবি পেয়ে থাকে তবে এটি পিতামাতা বা অভিভাবককে অবহিত করবে।

এই ছবিগুলি প্রাথমিকভাবে অস্পষ্ট এবং একটি বার্তার মাধ্যমে, এটি নাবালককে (যদি তাদের বয়স 12 বছর বা তার কম হয়) ব্যাখ্যা করা হবে যে ছবিটি তাদের জন্য উপযুক্ত নয়। যদি আপনি এটি দেখতে বেছে নেন, তাহলে অভিভাবকরা ছবি সহ একটি বিজ্ঞপ্তি পাবেন। এই অর্থে, এটি আরও যুক্তিযুক্ত হবে বাবা-মাই নাবালিকাকে ছবিটিতে প্রবেশের অনুমতি দিয়েছিলেন.

বার্তা অ্যাপ্লিকেশন মাধ্যমে প্রাপ্ত ছবি, ডিভাইসে স্ক্যান করা হবে এবং সেই তথ্য সেখান থেকে বের হবে না। কর্তৃপক্ষ বা অ্যাপল উভয়েরই ইভেন্ট সম্পর্কে জ্ঞান থাকবে না।

সিরি

সিরি শিশু পর্নোগ্রাফির বিরুদ্ধে লড়াইয়েও যোগ দিয়েছে। IOS 15, iPadOS 15, এবং macOS Monterrey রিলিজের সাথে, যদি কোন ব্যবহারকারী এই ধরনের বিষয়বস্তু অনুসন্ধান করে, আপনি একটি বিজ্ঞপ্তি পাবেন যা আপনাকে অবহিত করবে যে আপনি অবৈধ বলে বিবেচিত সামগ্রীর অনুসন্ধান করছেন এবং এটি আপনাকে জানাবে যে আপনি কোথায় সাহায্য পেতে পারেন এবং এই ধরনের বিষয়বস্তুর প্রতিবেদন করার উপায়।

এই প্রক্রিয়া, মেসেজ অ্যাপ্লিকেশনের মাধ্যমে প্রাপ্ত ইমেজের বিশ্লেষণের মতো, ডিভাইসে অভ্যন্তরীণভাবে পরিচালিত হবে, অ্যাপল বা কর্তৃপক্ষের জ্ঞান ছাড়াই।