Appleपलने जाहीर केल्यापासून iOS, iPadOS आणि macOS साठी बाल लैंगिक अत्याचार साहित्याचा शोध या महिन्याच्या सुरुवातीला खूप वाद झाला. केवळ सुरक्षा तज्ञांमध्येच नाही, तर Appleपलच्या स्वतःच्या कर्मचाऱ्यांमध्येही ज्यांनी Appleपलला ते लागू न करण्यास सांगितले आहे.

या प्रणालीच्या अंमलबजावणीवर अस्वस्थतेत सामील होणारे शेवटचे आहेत 90 नागरी हक्क गट. त्यांनी Appleपलला एक खुले पत्र लिहिले आहे आणि त्याला त्याच्या सीएसएएम (बाल लैंगिक अत्याचार सामग्री) योजनांवर मागे जाण्यास सांगितले आहे. त्यांचे म्हणणे असे आहे की ही प्रणाली इतर हेतूंसाठी वापरली जाऊ शकते.

CSAM म्हणजे काय?

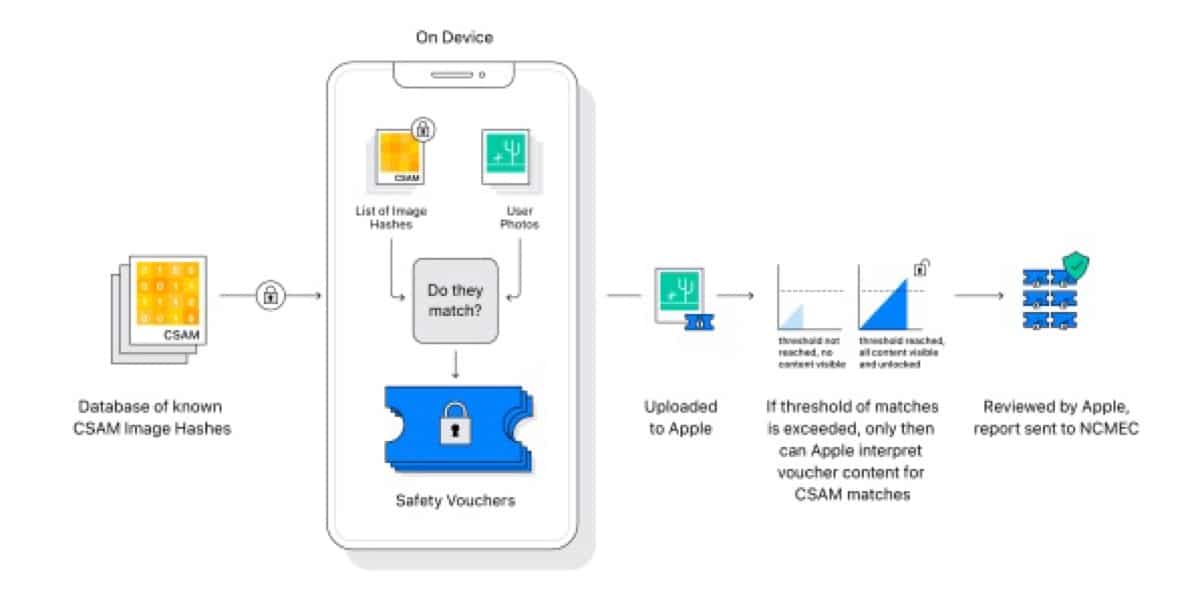

सीएसएएम, बाल लैंगिक अत्याचार सामग्री म्हणून अनुवादित, एक आहे बाल पोर्नोग्राफीच्या सामग्रीसह छायाचित्रांचे कॅटलॉग, ज्ञात, तयार आणि अद्यतनित वेळोवेळी वेगवेगळ्या संघटनांद्वारे आणि ज्यांचे आशय नॅशनल सेंटर फॉर मिसिंग आणि एक्सप्लोयटेड चिल्ड्रन (NCMEC) द्वारे नियंत्रित केले जाते.

या डेटाबेसमध्ये साठवलेल्या प्रत्येक छायाचित्रात एक अद्वितीय डिजिटल स्वाक्षरी आहे, एक डिजिटल स्वाक्षरी आहे त्याची तुलना iCloud वापरकर्त्याच्या खात्यांमध्ये साठवलेल्या फोटोंच्या प्रतिमांशी केली जाईल. जुळणी आढळल्यास, वापरकर्त्याच्या खात्यात प्रवेश अवरोधित केला जाईल आणि अधिकाऱ्यांना सूचित केले जाईल.

गुगल, ड्रॉपबॉक्स आणि मायक्रोसॉफ्ट काही काळापासून वापरकर्ता खात्यांसाठी ही इमेज ट्रॅकिंग सिस्टीम वापरत आहेत, पण अॅपल एक पाऊल पुढे गेले आहे आणि ने न्यूरलहॅश नावाची एक नवीन प्रणाली तयार केली आहे, जी सिस्टीममध्ये वापरकर्त्याच्या एन्क्रिप्टेड क्लाउडचे विश्लेषण करते, या प्रकारच्या प्रतिमा शोधत आहे आणि ज्यामध्ये अॅपलला देखील प्रवेश नाही.

नागरी हक्क संघटनांकडून नाराज

entre या पत्रावर काही स्वाक्षरी करणारे अमेरिकन सिव्हिल लिबर्टीज युनियन, कॅनेडियन सिव्हिल लिबर्टीज असोसिएशन, ऑस्ट्रेलियन संस्था डिजिटल राइट्स वॉच, ब्रिटिश संस्था लिबर्टी, प्रायव्हसी इंटरनॅशनल ...

पत्राची सुरुवात न्यूरलहॅशच्या क्षमतेवर प्रकाश टाकून होते, असे सांगून:

मुलांचे संरक्षण आणि बाल लैंगिक अत्याचार साहित्याचा प्रसार कमी करण्यासाठी (सीएसएएम) क्षमतेचा हेतू असला तरी, आम्ही चिंतेत आहोत की याचा वापर संरक्षित अभिव्यक्ती सेन्सॉर करण्यासाठी, जगभरातील लोकांची गोपनीयता आणि सुरक्षितता धोक्यात आणण्यासाठी केला जातो आणि अनेक मुलांसाठी घातक परिणाम होतात .

एकदा ही क्षमता Appleपल उत्पादनांमध्ये समाविष्ट झाल्यावर, कंपनी आणि त्याच्या प्रतिस्पर्ध्यांना प्रचंड दबाव - आणि संभाव्य कायदेशीर आवश्यकतांचा सामना करावा लागेल - जगभरातील सरकारांकडून केवळ सीएसएएमच नव्हे तर इतर प्रतिमांचे फोटो स्कॅन करण्यासाठी सरकारला शंकास्पद वाटते.

त्या प्रतिमा मानवाधिकारांचे उल्लंघन, राजकीय निषेध, कंपन्यांना 'दहशतवादी' किंवा हिंसक अतिरेकी आशय म्हणून लेबल केलेल्या प्रतिमा किंवा स्वत: राजकारण्यांच्या अतुलनीय प्रतिमा असू शकतात जे त्यांना स्कॅन करण्यासाठी कंपनीवर दबाव आणतील.

या 90 संघटनांचा दावा आहे की छायाचित्रांचा शोध डिव्हाइसवर साठवलेल्या प्रतिमांपर्यंत वाढवता येऊ शकते, केवळ आयक्लॉडमध्ये साठवलेलेच नाही, तर Appleपलने जगभरात सेन्सॉरशिप, पाळत ठेवणे आणि छळासाठी आधार तयार केला असेल.

हे असे म्हणता येत नाही की जेव्हा एखादे सरकार Appleपलला चीन किंवा रशिया सारख्या वापरकर्त्यांच्या सामग्रीमध्ये प्रवेश देण्याचा आग्रह करते, Appleपल डोके टेकवतो आणि त्याच्या मागण्यांचे पालन करतो. कोण आम्हाला आश्वासन देतो की Appleपल इतर देशांसह समान धोरणाचे पालन करणार नाही?

पत्रात असे म्हटले आहे की ही प्रणाली मुलांना धोका देईल:

Appleपलने विकसित केलेली प्रणाली असे गृहीत धरते की "पालक" आणि "बाल" खाती प्रत्यक्षात एखाद्या प्रौढ व्यक्तीची आहेत जी मुलाचे पालक आहेत आणि या व्यक्तींचे निरोगी संबंध आहेत.

हे नेहमीच होत नाही; एक अपमानास्पद प्रौढ खाते आयोजक असू शकतो आणि पालकांना सूचित करण्याच्या परिणामामुळे मुलाची सुरक्षा आणि कल्याण धोक्यात येऊ शकते. LGBTQ + सहानुभूती नसलेल्या पालकांसह कौटुंबिक खात्यातील तरुणांना विशेषतः धोका असतो

मुलांचे अत्याचार कमी करण्यासाठी अॅपलचे प्रयत्न असूनही कंपनीने असे सांगून पत्र संपते गोपनीयता धोरणात ठाम राहिले पाहिजे त्याने अलिकडच्या वर्षांत बांधले आहे.

आम्ही मुलांचे संरक्षण करण्याच्या प्रयत्नांचे समर्थन करतो आणि CSAM च्या प्रसाराला तीव्र विरोध करतो. परंतु Appleपलने जाहीर केलेल्या बदलांमुळे मुले आणि इतर वापरकर्ते आता आणि भविष्यातही धोक्यात आले आहेत. आम्ही अॅपलला विनंती करतो की ते बदल सोडून द्या आणि कंपनीच्या वापरकर्त्यांना एंड-टू-एंड एन्क्रिप्शनसह संरक्षित करण्याच्या वचनबद्धतेची पुष्टी करा. आम्ही अॅपलला नागरी समाज गट आणि असुरक्षित समुदायाशी अधिक नियमितपणे सल्ला घेण्याचे आवाहन करतो जे त्यांच्या उत्पादनांमध्ये आणि सेवांमधील बदलांमुळे असमान प्रमाणात प्रभावित होऊ शकतात.

संदेश

अॅपल हे नवीन फिचर सादर करणार आहे मॅकओएस मॉन्टेरी, आयओएस 15 आणि आयपॅडओएस 15 च्या रिलीझसह, मेसेज applicationप्लिकेशनद्वारे बाल लैंगिक साहित्याचा प्रसार ओळखणारी एक प्रणाली असलेली एक फंक्शन आणि जे अल्पवयीन व्यक्तीला लैंगिक अंतर्भूत म्हणून वर्गीकृत प्रतिमा प्राप्त झाल्यास पालक किंवा पालकांना सूचित करेल.

या प्रतिमा सुरुवातीला अस्पष्ट दिसतील आणि एका संदेशाद्वारे, अल्पवयीन (जर ते 12 वर्षांचे किंवा त्यापेक्षा कमी असतील तर) हे स्पष्ट केले जाईल की प्रतिमा त्यांच्यासाठी योग्य नाही. आपण ते पाहण्याचा निर्णय घेतल्यास, पालकांना प्रतिमेसह सूचना प्राप्त होईल. या अर्थाने, ते अधिक उचित होईल आई-वडिलांनीच अल्पवयीन मुलाला प्रतिमेवर प्रवेश मिळवून दिला.

संदेश अनुप्रयोगाद्वारे प्राप्त प्रतिमा, डिव्हाइसवर स्कॅन केले जाईल आणि ती माहिती तिथून बाहेर येणार नाही. अधिकाऱ्यांना किंवा Appleपलला या घटनेचे ज्ञान नसेल.

Siri

सिरी देखील बाल अश्लीलतेविरूद्धच्या लढ्यात सामील झाली आहे. IOS 15, iPadOS 15 आणि macOS Monterrey च्या रिलीझसह, जर वापरकर्त्याने या प्रकारच्या सामग्रीचा शोध घेतला, तुम्हाला अवैध समजल्या जाणाऱ्या साहित्याचा शोध घेत असल्याची माहिती देणारी सूचना तुम्हाला प्राप्त होईल आणि तुम्हाला मदत कुठे मिळेल आणि अशा सामग्रीची तक्रार करण्याचे साधन तुम्हाला कळवेल.

ही प्रक्रिया, संदेश अनुप्रयोगाद्वारे प्राप्त प्रतिमांच्या विश्लेषणाप्रमाणे, डिव्हाइसवर अंतर्गत केली जाईल, Appleपल किंवा अधिकाऱ्यांच्या माहितीशिवाय.