Siden Apple kunngjorde påvisning av seksuelt misbruk av barn for iOS, iPadOS og macOS Tidligere denne måneden var det mye debatt. Ikke bare blant sikkerhetseksperter, men også blant Apples egne ansatte som har bedt Apple om ikke å implementere det.

De siste som ble med på ubehag over implementeringen av dette systemet er mer enn 90 borgerrettighetsgrupper. De har skrevet et åpent brev til Apple og bedt det om å gå tilbake til CSAM -planene sine (Child Sexual Abuse Material). Grunnen til at de hentyder er at dette systemet kan utnyttes til andre formål.

Hva er CSAM?

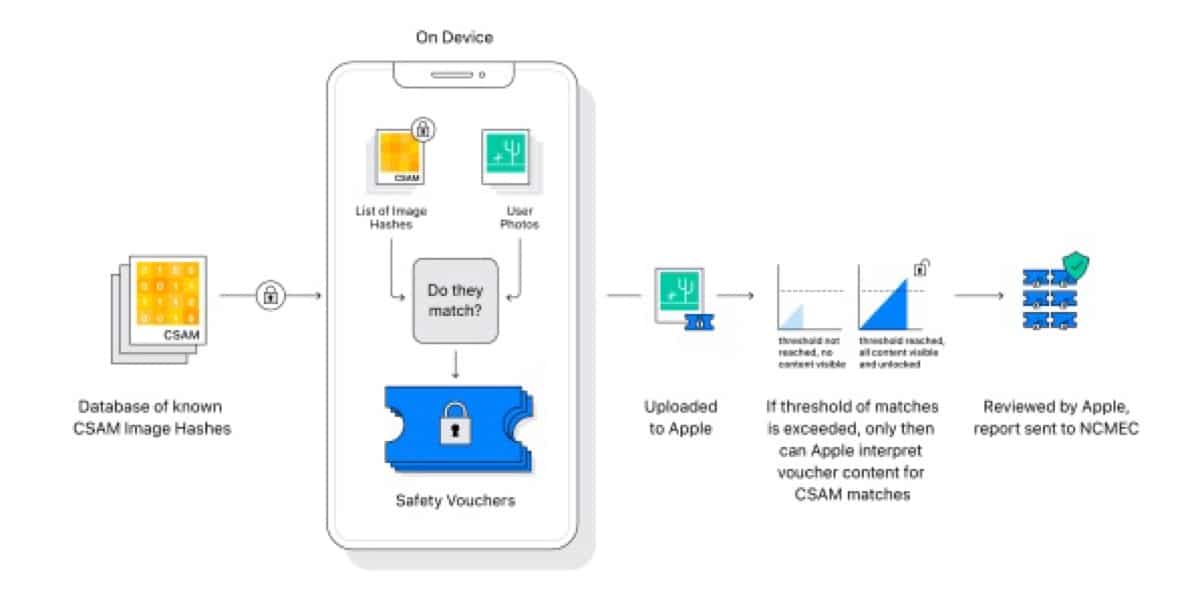

CSAM, oversatt som seksuelt misbruk av barn, er en katalog over fotografier med innhold fra barnepornografi, kjent, utarbeidet og oppdatert med jevne mellomrom av forskjellige foreninger og hvis innhold kontrolleres av National Center for Missing and Exploited Children (NCMEC).

Hver av fotografiene som er lagret i denne databasen har en unik digital signatur, en digital signatur som den vil bli sammenlignet med bildene av bildene som er lagret i iCloud -brukernes kontoer. Hvis det oppdages en kamp, vil tilgang til brukerens konto bli blokkert og myndighetene vil bli varslet.

Google, Dropbox og Microsoft har brukt dette bildesporingssystemet for brukerkontoer en stund, men Apple har gått et skritt videre og har opprettet et nytt system som heter NeuralHash, et system som analyserer brukerens krypterte sky, i teorien, på jakt etter denne typen bilder og som ikke engang Apple selv har tilgang til.

Opprørt fra borgerrettighetsorganisasjoner

Mellom noen av undertegnerne av dette brevet er American Civil Liberties Union, Canadian Civil Liberties Association, den australske organisasjonen Digital Rights Watch, British Liberty, Privacy International ...

Brevet begynner med å markere mulighetene til NeuralHash, og sier at:

Selv om evner er ment å beskytte barn og redusere spredningen av materiale for seksuelt misbruk av barn (CSAM), er vi bekymret for at det brukes til å sensurere beskyttet uttrykk, true personvernet og sikkerheten til mennesker rundt om i verden og ha katastrofale konsekvenser for mange barn .

Når denne evnen er innlemmet i Apple -produkter, vil selskapet og konkurrentene møte et enormt press - og potensielt lovlige krav - fra myndigheter over hele verden for å skanne bilder for ikke bare CSAM, men også av andre bilder som en regjering anser som tvilsomme.

Disse bildene kan være av menneskerettighetsbrudd, politiske protester, bilder som selskaper har stemplet som 'terrorist' eller voldelig ekstremistisk innhold, eller til og med flatterende bilder av politikerne selv som vil presse selskapet til å skanne dem.

Disse 90 organisasjonene hevder at søket etter fotografier kan utvides til bilder som er lagret på enheten, ikke bare de som er lagret i iCloud, så Apple kan ha skapt grunnlaget for sensur, overvåking og forfølgelse over hele verden.

Det sier seg selv at når en regjering oppfordrer Apple til å gi tilgang til innholdet til brukerne, for eksempel Kina eller Russland, Apple bøyer hodet og oppfyller kravene hans. Hvem forsikrer oss om at Apple ikke vil følge den samme politikken med andre land?

I brevet står det videre at dette systemet vil sette barn i fare:

Systemet som Apple har utviklet forutsetter at de involverte "foreldre" og "barn" -kontoene faktisk tilhører en voksen som er forelder til et barn, og at disse personene har et sunt forhold.

Dette er ikke alltid tilfelle; en voldelig voksen kan være kontoorganisatoren, og konsekvensene av å varsle foreldre kan true barnets sikkerhet og velvære. LGBTQ + ungdom i familiekontoer med usympatiske foreldre er spesielt utsatt

Brevet avsluttes med at det til tross for Apples innsats for å redusere overgrep mot barn, selskapet må være fast i personvernerklæringen som han har bygd de siste årene.

Vi støtter arbeidet med å beskytte barn og er sterkt imot spredning av CSAM. Men endringene som Apple har kunngjort setter barn og andre brukere i fare, både nå og i fremtiden. Vi oppfordrer Apple til å forlate disse endringene og bekrefte selskapets engasjement for å beskytte brukerne med ende-til-ende-kryptering. Vi oppfordrer også Apple til å rådføre seg mer regelmessig med sivilsamfunnsgrupper og sårbare lokalsamfunn som kan bli uforholdsmessig påvirket av endringer i sine produkter og tjenester.

Innlegg

Apple vil introdusere denne nye funksjonen med utgivelsen av macOS Monterey, iOS 15 og iPadOS 15, en funksjon som er ledsaget av et system som vil oppdage spredning av seksuelt seksuelt materiale gjennom meldingsprogrammet, og som vil varsle foreldre eller foresatte hvis den mindreårige har mottatt bilder klassifisert som seksuelt implisitte.

Disse bildene vil i utgangspunktet virke uklare og gjennom en melding vil det bli forklart for den mindreårige (hvis de er 12 år eller yngre) at bildet ikke er egnet for dem. Hvis du velger å se det, vil foreldrene motta et varsel sammen med bildet. Sånn sett ville det vært mer tilrådelig det var foreldrene som ga klarsignal for at den mindreårige skulle ha tilgang til bildet.

Bilder mottatt gjennom meldingsprogrammet, blir skannet på enheten og at informasjonen ikke kommer ut av det. Verken myndigheter eller Apple vil ha kjennskap til hendelsen.

Siri

Siri har også sluttet seg til kampen mot barnepornografi. Med utgivelsen av iOS 15, iPadOS 15 og macOS Monterrey, hvis en bruker søker etter denne typen innhold, du vil motta en melding om at du søker etter materiale som anses ulovlig og det vil informere deg om hvor du kan finne hjelp og hvordan du kan rapportere slikt innhold.

Denne prosessen, i likhet med analyse av bilder mottatt via Meldinger -applikasjonen, vil bli utført internt på enheten, uten kunnskap fra Apple eller myndighetene.