De când Apple a anunțat detectarea materialelor de abuz sexual asupra copiilor pentru iOS, iPadOS și macOS La începutul acestei luni, a existat o mulțime de dezbateri. Nu doar în rândul experților în securitate, ci chiar și în rândul angajaților Apple care i-au cerut Apple să nu-l implementeze.

Ultimii care s-au alăturat stării de rău cu privire la implementarea acestui sistem sunt mai mult decât 90 de grupuri pentru drepturile civile. Aceștia au scris o scrisoare deschisă către Apple, cerându-i să retragă planurile CSAM (Material sexual pentru abuz sexual infantil). Motivul pentru care fac aluzie este că acest sistem poate fi exploatat în alte scopuri.

Ce este CSAM?

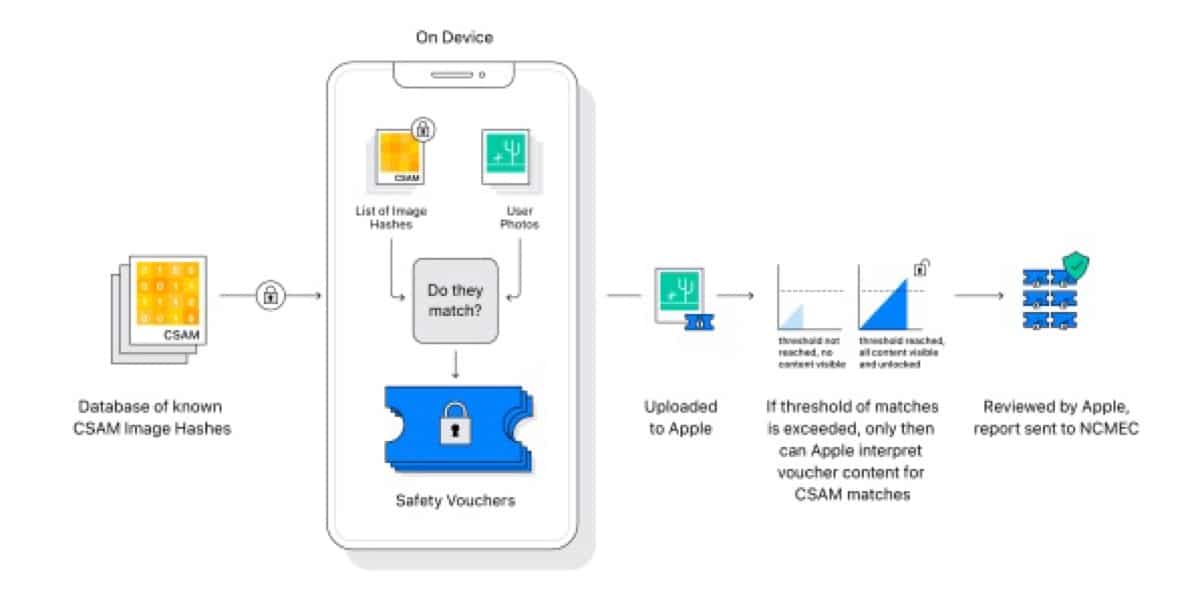

CSAM, tradus ca material de abuz sexual asupra copiilor, este un catalog de fotografii cu conținut de pornografie infantilă, cunoscut, pregătit și actualizat periodic de diferite asociații și al căror conținut este controlat de Centrul Național pentru Copii Dispăruți și Exploatați (NCMEC).

Fiecare dintre fotografiile stocate în această bază de date are o semnătură digitală unică, o semnătură digitală care va fi comparat cu imaginile fotografiilor stocate în conturile utilizatorilor iCloud. Dacă se detectează o potrivire, accesul la contul utilizatorului va fi blocat și autoritățile vor fi notificate.

Google, Dropbox și Microsoft folosesc de ceva timp acest sistem de urmărire a imaginilor pentru conturile de utilizator, dar Apple a făcut un pas mai departe și a creat un nou sistem numit NeuralHash, un sistem care analizează, în teorie, cloudul criptat al utilizatorului, căutând aceste tipuri de imagini și la care nici măcar Apple nu are acces.

Supărat de organizațiile pentru drepturile civile

Între unii dintre semnatarii acestei scrisori sunt American Civil Liberties Union, Canadian Civil Liberties Association, organizația australiană Digital Rights Watch, British Liberty, Privacy International ...

Scrisoarea începe prin evidențierea capacităților NeuralHash, afirmând că:

Deși capabilitățile sunt destinate protejării copiilor și reducerii răspândirii materialelor pentru abuz sexual sexual asupra copiilor (CSAM), ne îngrijorează faptul că este folosit pentru a cenzura expresia protejată, pentru a amenința intimitatea și siguranța oamenilor din întreaga lume și pentru a avea consecințe dezastruoase pentru mulți copii. .

Odată ce această capacitate este încorporată în produsele Apple, compania și concurenții săi se vor confrunta cu presiuni enorme - și cu potențiale cerințe legale - din partea guvernelor din întreaga lume pentru a scana fotografii nu doar pentru CSAM, ci și a altor imagini pe care un guvern le consideră îndoielnice.

Aceste imagini pot fi abuzuri ale drepturilor omului, proteste politice, imagini pe care companiile le-au etichetat drept „teroriste” sau conținut extremist violent, sau chiar imagini neplătești ale politicienilor înșiși care vor presiona compania să le scaneze.

Aceste 90 de organizații susțin că căutarea fotografiilor poate fi extins la imaginile stocate pe dispozitiv, nu doar cele stocate în iCloud, deci este posibil ca Apple să fi creat baza cenzurii, supravegherii și persecuției la nivel mondial.

Este de la sine înțeles că, atunci când un guvern îndeamnă Apple să acorde acces la conținutul utilizatorilor săi, precum China sau Rusia, Apple înclină capul și vă satisface cerințele. Cine ne asigură că Apple nu va urma aceeași politică cu alte țări?

Scrisoarea continuă să precizeze că acest sistem va pune copiii în pericol:

Sistemul dezvoltat de Apple presupune că conturile „părinte” și „copil” implicate aparțin de fapt unui adult care este părintele unui copil și că acești indivizi au o relație sănătoasă.

Nu este întotdeauna cazul; un adult abuziv poate fi organizatorul contului, iar consecințele notificării părinților ar putea amenința siguranța și bunăstarea copilului. Tinerii LGBTQ + din conturile familiale cu părinți nesimpatici sunt în special expuși riscului

Scrisoarea se încheie afirmând că, în ciuda eforturilor Apple de a reduce abuzul asupra copiilor, compania trebuie să rămână fermă în politica de confidențialitate pe care a construit-o în ultimii ani.

Susținem eforturile de protejare a copiilor și ne opunem cu tărie proliferării CSAM. Dar schimbările pe care Apple le-a anunțat îi pune pe copii și pe ceilalți utilizatori în pericol, atât în prezent, cât și în viitor. Îl îndemnăm pe Apple să abandoneze aceste modificări și să reafirme angajamentul companiei de a-și proteja utilizatorii cu criptare end-to-end. De asemenea, îndemnăm Apple să se consulte mai regulat cu grupurile societății civile și cu comunitățile vulnerabile care pot fi afectate în mod disproporționat de modificările produselor și serviciilor sale.

Posturi

Apple va introduce această nouă caracteristică odată cu lansarea macOS Monterey, iOS 15 și iPadOS 15, o funcție care este însoțită de un sistem care va detecta diseminarea materialului sexual al copilului prin aplicația Mesaje și care va anunța părintele sau tutorele dacă minorul a primit imagini clasificate drept implicite sexual.

Aceste imagini vor apărea inițial neclare și printr-un mesaj, se va explica minorului (dacă au 12 ani sau mai puțin) că imaginea nu este potrivită pentru ei. Dacă alegeți să o vizualizați, părinții vor primi o notificare împreună cu imaginea. În acest sens, ar fi mai indicat ca. Părinții au fost cei care au dat acordul pentru ca minorul să aibă acces la imagine.

Imagini primite prin intermediul aplicației Mesaje, va fi scanat pe dispozitiv iar acele informații nu vor ieși de acolo. Nici autoritățile, nici Apple nu vor cunoaște evenimentul.

Siri

Siri s-a alăturat, de asemenea, luptei împotriva pornografiei infantile. Odată cu lansarea iOS 15, iPadOS 15 și macOS Monterrey, dacă un utilizator caută acest tip de conținut, veți primi o notificare care vă informează că efectuați o căutare a materialului considerat ilegal și vă va informa despre unde puteți găsi ajutor și despre modalitățile de raportare a unui astfel de conținut.

Acest proces, ca și analiza imaginilor primite prin intermediul aplicației Mesaje, va fi realizat intern pe dispozitiv, fără știrea Apple sau a autorităților.