Desde que Apple anunció la detección de material de abuso sexual infantil para iOS, iPadOS y macOS a principios de este mes, se ha generado un amplio debate. No solo entre los expertos en seguridad, sino incluso entre los propios empleados de Apple quienes han pedido a Apple que no lo implemente.

Los últimos en unirse al malestar por la implementación de este sistema son más de 90 grupos de derechos civiles. Estos han escrito una carta abierta a Apple, pidiéndole que dé marcha atrás en sus planes de CSAM (Child Sexual Abuse Material). El motivo que aluden es que este sistema puede ser explotado con otros fines.

¿Qué es CSAM?

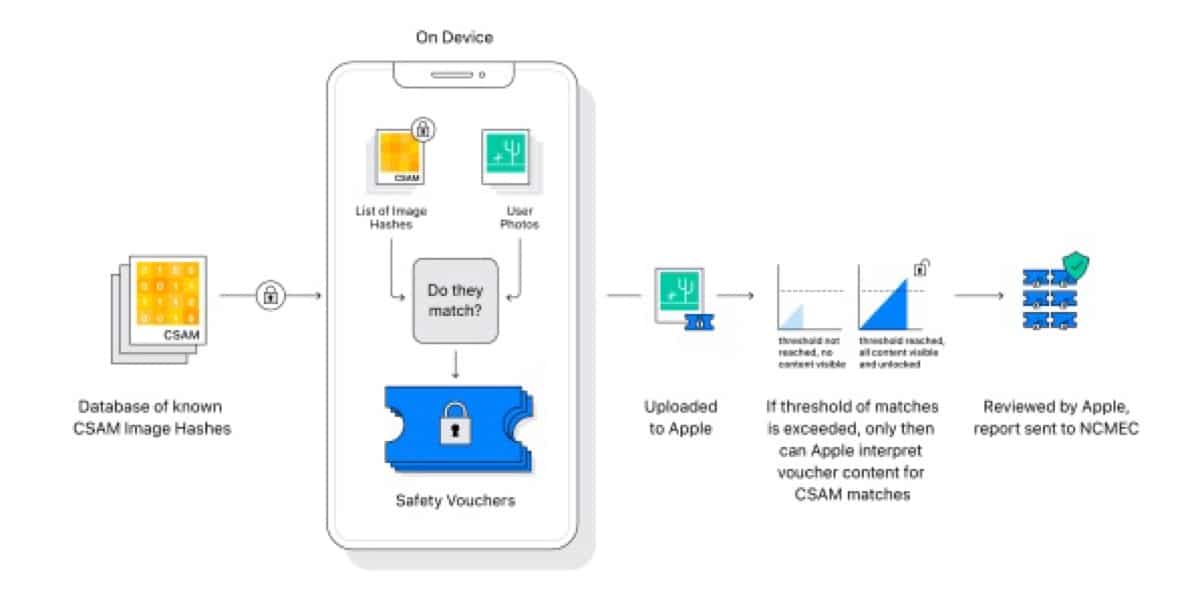

CSAM, traducido como Material de abuso sexual infantil, es un catálogo de fotografías con contenido de pornografía infantil, conocido, elaborado y actualizado periódicamente por diferentes asociaciones y cuyo contenido es controlado por el National Center for Missing and Exploited Children (NCMEC).

Cada una de las fotografías almacenadas en esta base de datos, tiene una firma digital única, firma digital que se comparará con las imágenes de las fotografías almacenadas en las cuentas de los usuarios de iCloud. Si se detecta alguna coincidencia, se bloqueará el acceso a la cuenta del usuario y se avisará a las autoridades.

Google, Dropbox y Microsoft llevan tiempo utilizando este sistema de rastreo de imágenes en las cuentas de usuarios, pero Apple ha ido un paso más allá y ha creado un nuevo sistema bautizado como NeuralHash, un sistema que analiza la, en teoría, nube cifrada del usuario buscando este tipo de imágenes y la que ni la propia Apple tiene acceso.

Malestar de las organizaciones de derechos civiles

Entre algunos los firmantes de esta carta se encuentran la Unión Americana de Libertades Civiles, la Asociación Canadiense de Libertades Civiles, la organización australiana Digital Rights Watch, la británica Liberty, Privacy International…

La carta comienza destacando las capacidades de NeuralHash, afirmando que:

Aunque capacidades están destinadas a proteger a los niños y a reducir la difusión de material de abuso sexual infantil (CSAM), nos preocupa que se utilicen para censurar la expresión protegida, amenazar la privacidad y la seguridad de las personas en todo el mundo, y tener consecuencias desastrosas para muchos niños.

Una vez que esta capacidad se incorpore a los productos de Apple, la empresa y sus competidores se enfrentarán a una enorme presión -y potencialmente a exigencias legales- de gobiernos de todo el mundo para que escaneen las fotos no sólo en busca de CSAM, sino también de otras imágenes que un gobierno considere cuestionables.

Esas imágenes pueden ser de abusos de los derechos humanos, protestas políticas, imágenes que las empresas han etiquetado como contenido ‘terrorista’ o extremista violento, o incluso imágenes poco favorecedoras de los propios políticos que presionarán a la empresa para que las escanee.

Estas 90 organizaciones afirma que la búsqueda de fotografías podría extenderse a las imágenes almacenas en el dispositivo, no únicamente las que se almacenan en iCloud, por lo que Apple puede haber creado las bases para la censura vigilancia y persecución a nivel mundial.

No hace falta recordar que cuando un gobierno le insta a Apple a conceder acceso al contenido de sus usuarios, como por ejemplo China o Rusia, Apple agacha la cabeza y cumple con sus exigencias. ¿Quién nos asegura que Apple no seguirá esta misma política con otros países?

La carta continúa afirmando que este sistema pondrá en riesgo a los niños:

El sistema que Apple ha desarrollado supone que las cuentas de «padre» y «niño» implicadas pertenecen realmente a un adulto que es el padre de un niño, y que esos individuos tienen una relación sana.

Esto no siempre es así; un adulto abusivo puede ser el organizador de la cuenta, y las consecuencias de la notificación a los padres podrían amenazar la seguridad y el bienestar del niño. Los jóvenes LGBTQ+ en cuentas familiares con padres poco comprensivos están especialmente en riesgo

La carta finaliza apuntando a que a pesar de los esfuerzos por reducir el abuso de menores de Apple, la empresa debe mantenerse firme en los política de privacidad que ha construido estos últimos años.

Apoyamos los esfuerzos para proteger a los niños y nos oponemos firmemente a la proliferación de CSAM. Pero los cambios que Apple ha anunciado ponen en riesgo a los niños y al resto de usuarios, tanto ahora como en el futuro. Instamos a Apple a que abandone esos cambios y a que reafirme el compromiso de la compañía de proteger a sus usuarios con el cifrado de extremo a extremo. También instamos a Apple a que consulte con mayor regularidad a los grupos de la sociedad civil y a las comunidades vulnerables que puedan verse afectadas de forma desproporcionada por los cambios en sus productos y servicios.

Mensajes

Apple introducirá esta nueva función con el lanzamiento de macOS Monterey, iOS 15 y iPadOS 15, una función que va acompañada de un sistema que detectará la difusión de material sexual infantil a través de la aplicación Mensajes y que notificará al padre o tutor si el menor ha recibido imágenes catalogadas como sexualmente implícitas.

Estas imágenes se mostrarán inicialmente borrosas y a través de mensaje, se explicará al menor (si tiene 12 años o menos) que la imagen no es adecuada para él. Si decida verla, los padres recibirán una notificación junto con la imagen. En este sentido, sería más recomendable que fueran los padres quienes dieran el visto bueno para que el menor tenga acceso a la imagen.

Las imágenes que se reciban a través de la aplicación Mensajes, se analizarán en el dispositivo y esa información no saldrá de ahí. Ni las autoridades ni Apple tendrán conocimiento del suceso.

Siri

Siri también se ha unido a la lucha contra la pornografía infantil. Con el lanzamiento de iOS 15, iPadOS 15 y macOS Monterrey, si un usuario realiza una búsqueda de este tipo de contenido, recibirá una notificación informándole que está realizando una búsqueda de material considerado como ilegal y le informará de donde puede encontrar ayuda y de medios que le permitirán denunciar ese tipo de contenido.

Este proceso, al igual que el análisis de imágenes recibidas a través de la aplicación Mensajes, se realizará de forma interna en el dispositivo, sin que Apple o las autoridades tengan conocimiento.