Od té doby, co Apple oznámil detekce materiálu pro sexuální zneužívání dětí pro iOS, iPadOS a macOS Začátkem tohoto měsíce se hodně debatovalo. Nejen mezi bezpečnostními experty, ale dokonce i mezi vlastními zaměstnanci Apple, kteří požádali Apple, aby jej neimplementoval.

Poslední, kdo se přidal k malátnosti ohledně implementace tohoto systému, je více než 90 skupin občanských práv. Napsali otevřený dopis společnosti Apple a požádali ji, aby ustoupila od svých plánů CSAM (Material Sexual Abuse Material). Důvod, proč se zmiňují, je, že tento systém lze využít k jiným účelům.

Co je CSAM?

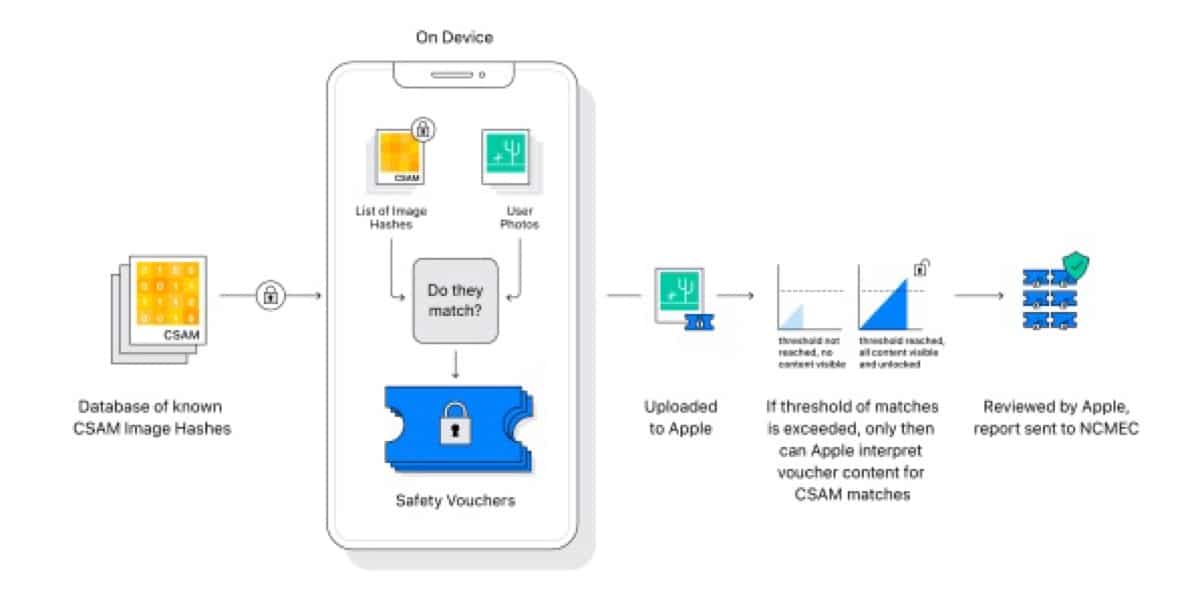

CSAM, v překladu materiál pro sexuální zneužívání dětí, je a katalog fotografií s obsahem dětské pornografie, známý, připravený a aktualizovaný pravidelně různými asociacemi a jejichž obsah kontroluje Národní centrum pro pohřešované a zneužívané děti (NCMEC).

Každá z fotografií uložených v této databázi má jedinečný digitální podpis, digitální podpis, který bude porovnáno s obrázky fotografií uložených v uživatelských účtech iCloud. Pokud je nalezena shoda, přístup k účtu uživatele bude zablokován a orgány budou informovány.

Google, Dropbox a Microsoft již nějaký čas používají tento systém pro sledování obrázků pro uživatelské účty, ale Apple šel ještě o krok dále a vytvořil nový systém s názvem NeuralHash, systém, který teoreticky analyzuje šifrovaný cloud uživatele a hledá tyto typy obrázků, ke kterým nemá přístup ani samotný Apple.

Rozčilení od organizací občanských práv

Mezi někteří ze signatářů tohoto dopisu jsou American Civil Liberties Union, Canadian Civil Liberties Association, australská organizace Digital Rights Watch, British Liberty, Privacy International ...

Dopis začíná zdůrazněním schopností NeuralHash a uvádí, že:

Přestože jsou schopnosti určeny k ochraně dětí a omezují šíření materiálu pro sexuální zneužívání dětí (CSAM), obáváme se, že slouží k cenzuře chráněného projevu, ohrožení soukromí a bezpečnosti lidí na celém světě a má katastrofální důsledky pro mnoho dětí .

Jakmile bude tato schopnost začleněna do produktů Apple, bude společnost a její konkurenti čelit obrovskému tlaku - a potenciálně zákonným požadavkům - ze strany vlád po celém světě, aby skenovaly fotografie nejen pro CSAM, ale i pro další obrázky, které vláda považuje za diskutabilní.

Mohou to být případy porušování lidských práv, politické protesty, obrázky, které společnosti označily jako „teroristický“ nebo násilný extremistický obsah, nebo dokonce nelichotivé obrázky samotných politiků, kteří budou tlačit na společnost, aby je skenovala.

Těchto 90 organizací tvrdí, že hledání fotografií lze rozšířit na obrázky uložené v zařízení, nejen ty, které jsou uloženy v iCloudu, takže Apple možná vytvořil základ pro cenzuru, sledování a pronásledování po celém světě.

Je samozřejmé, že když vláda naléhá na společnost Apple, aby udělila přístup k obsahu svých uživatelů, jako je Čína nebo Rusko, Apple skloní hlavu a splní vaše požadavky. Kdo nás ujišťuje, že se Apple nebude řídit stejnými zásadami v jiných zemích?

Dopis dále uvádí, že tento systém vystaví děti riziku:

Systém, který společnost Apple vyvinula, předpokládá, že související účty „rodič“ a „dítě“ skutečně patří dospělé osobě, která je rodičem dítěte, a že tito jedinci mají zdravý vztah.

Není tomu tak vždy; organizátorem účtu může být zneužívající dospělá osoba a důsledky upozornění rodičů by mohly ohrozit bezpečnost a pohodu dítěte. Zvláště ohroženi jsou mladí LGBTQ + v rodinných účtech s nesympatickými rodiči

Dopis končí prohlášením, že i přes snahu Applu omezit zneužívání dětí společnost musí zůstat pevné v zásadách ochrany osobních údajů které v posledních letech vybudoval.

Podporujeme úsilí o ochranu dětí a důrazně se stavíme proti šíření CSAM. Změny, které společnost Apple oznámila, však ohrožují děti i další uživatele, a to jak nyní, tak i v budoucnosti. Naléhavě žádáme společnost Apple, aby od těchto změn upustila a znovu potvrdila závazek společnosti chránit své uživatele šifrováním typu end-to-end. Rovněž naléháme na společnost Apple, aby pravidelněji konzultovala se skupinami občanské společnosti a zranitelnými komunitami, které mohou být nepřiměřeně ovlivněny změnami jejích produktů a služeb.

Příspěvky

Apple tuto novou funkci představí s vydáním macOS Monterey, iOS 15 a iPadOS 15, funkce, která je doprovázena systémem, který detekuje šíření dětského sexuálního materiálu prostřednictvím aplikace Zprávy a který upozorní rodiče nebo opatrovníka, pokud nezletilý obdržel obrázky klasifikované jako sexuálně implicitní.

Tyto obrázky budou zpočátku vypadat rozmazané a prostřednictvím zprávy bude nezletilému (pokud je mu 12 let nebo mladší) vysvětleno, že pro ně není vhodný. Pokud se ho rozhodnete zobrazit, obdrží rodiče spolu s obrázkem oznámení. V tomto smyslu by bylo vhodnější to byli to rodiče, kteří dali souhlas, aby měl nezletilý přístup k obrazu.

Obrázky přijaté prostřednictvím aplikace Zprávy, budou naskenovány na zařízení a tyto informace odtamtud nevyjdou. Úřady ani Apple nebudou mít o události znalosti.

Siri

Siri se také zapojila do boje proti dětské pornografii. S vydáním iOS 15, iPadOS 15 a macOS Monterrey, pokud uživatel hledá tento typ obsahu, obdržíte oznámení informující o tom, že provádíte vyhledávání materiálu považovaného za nezákonný a bude vás informovat o tom, kde můžete najít pomoc, a způsobech, jak takový obsah nahlásit.

Tento proces, stejně jako analýza obrázků přijatých prostřednictvím aplikace Zprávy, bude prováděn interně na zařízení, bez vědomí společnosti Apple nebo úřadů.