Siitä lähtien, kun Apple ilmoitti lasten seksuaalisen hyväksikäytön materiaalin havaitseminen iOS-, iPadOS- ja macOS -käyttöjärjestelmille Aiemmin tässä kuussa oli paljon keskustelua. Ei vain turvallisuusasiantuntijoiden keskuudessa, vaan jopa Applen työntekijöiden keskuudessa, jotka ovat pyytäneet Applea olemaan toteuttamatta sitä.

Viimeiset, jotka ovat liittyneet huonovointisuuteen tämän järjestelmän käyttöönotossa, ovat enemmän kuin 90 kansalaisoikeusjärjestöä. He ovat kirjoittaneet avoimen kirjeen Applelle ja pyytäneet sitä palaamaan CSAM -suunnitelmaansa (Child Sexual Abuse Material). He viittaavat siihen, että tätä järjestelmää voidaan käyttää muihin tarkoituksiin.

Mikä on CSAM?

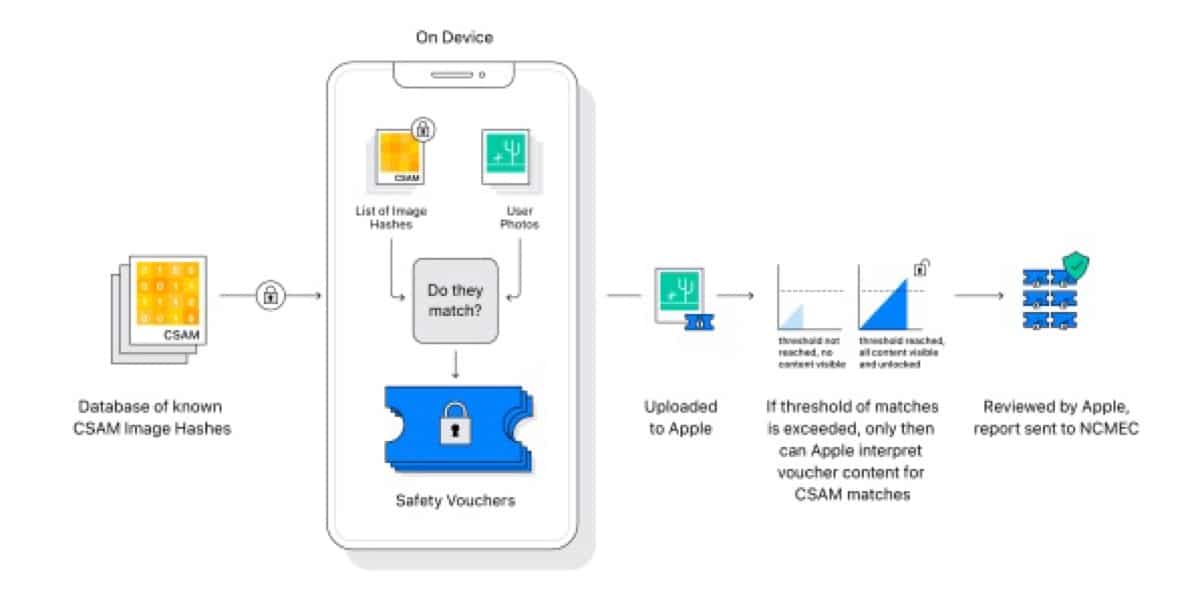

CSAM, käännetty lasten seksuaalisen hyväksikäytön materiaaliksi, on a luettelo valokuvista, joissa on lapsipornografiaa, tiedossa, valmisteltu ja päivitetty eri järjestöt säännöllisesti ja joiden sisältöä valvoo kadonnut ja hyväksikäytettyjen lasten kansallinen keskus (NCMEC).

Jokaisella tähän tietokantaan tallennetulla valokuvalla on ainutlaatuinen digitaalinen allekirjoitus sitä verrataan iCloud -käyttäjien tileille tallennettujen kuvien kuviin. Jos vastaavuus havaitaan, pääsy käyttäjän tilille estetään ja viranomaisille ilmoitetaan asiasta.

Google, Dropbox ja Microsoft ovat käyttäneet tätä kuvien seurantajärjestelmää käyttäjätileillä jo jonkin aikaa, mutta Apple on mennyt askeleen pidemmälle ja on luonut uuden järjestelmän nimeltä NeuralHash, järjestelmä, joka analysoi teoriassa käyttäjän salatun pilven ja etsii tämän tyyppisiä kuvia, joihin edes Apple itse ei pääse käsiksi.

Ärsyyntynyt kansalaisoikeusjärjestöiltä

Välillä jotkut tämän kirjeen allekirjoittajista ovat American Civil Liberties Union, Canadian Civil Liberties Association, australialainen Digital Rights Watch -järjestö, British Liberty, Privacy International ...

Kirje alkaa korostamalla NeuralHashin ominaisuuksia ja toteaa, että:

Vaikka ominaisuuksien on tarkoitus suojella lapsia ja vähentää lasten seksuaalisen hyväksikäytön materiaalin (CSAM) leviämistä, olemme huolissamme siitä, että sitä käytetään sensuroidun ilmaisun sensuroimiseen, ihmisten yksityisyyden ja turvallisuuden uhkaamiseen ympäri maailmaa ja tuhoisia seurauksia monille lapsille .

Kun tämä ominaisuus on sisällytetty Applen tuotteisiin, yhtiö ja sen kilpailijat kohtaavat valtavia paineita - ja mahdollisesti laillisia vaatimuksia - hallituksilta ympäri maailmaa skannaamaan valokuvia paitsi CSAM: n lisäksi myös muista kuvista, joita hallitus pitää kyseenalaisina.

Nämä kuvat voivat olla ihmisoikeusloukkauksia, poliittisia mielenosoituksia, kuvia, jotka yritykset ovat pitäneet "terroristiksi" tai väkivaltaiseksi ääriliikkeeksi, tai jopa epämiellyttäviä kuvia itse poliitikoista, jotka painostavat yritystä skannaamaan ne.

Nämä 90 organisaatiota väittävät, että valokuvien etsiminen voidaan laajentaa laitteeseen tallennettuihin kuviin, ei vain niitä, jotka on tallennettu iCloudiin, joten Apple on saattanut luoda perustan sensuurille, valvonnalle ja vainolle kaikkialla maailmassa.

On sanomattakin selvää, että kun hallitus kehottaa Applea myöntämään pääsyn käyttäjiensä, kuten Kiinan tai Venäjän, sisältöön, Apple kumartaa päänsä ja täyttää hänen vaatimukset. Kuka vakuuttaa meille, että Apple ei noudata samaa politiikkaa muiden maiden kanssa?

Kirjeessä todetaan, että tämä järjestelmä vaarantaa lapset:

Applen kehittämä järjestelmä olettaa, että "vanhempi" ja "lapsi" -tilit kuuluvat todella aikuiselle, joka on lapsen vanhempi, ja että näillä henkilöillä on terve suhde.

Näin ei ole aina; väkivaltainen aikuinen voi olla tilin järjestäjä, ja vanhemmille ilmoittamisen seuraukset voivat uhata lapsen turvallisuutta ja hyvinvointia. Erityisesti vaarassa ovat LGBTQ + -nuoret perhetileillä epäsympaattisten vanhempien kanssa

Kirje päättyy toteamalla, että huolimatta Applen pyrkimyksistä vähentää lasten hyväksikäyttöä, yritys on pysyttävä lujana tietosuojakäytännössä jonka hän on rakentanut viime vuosina.

Tuemme pyrkimyksiä suojella lapsia ja vastustamme voimakkaasti CSAM -leviämistä. Mutta Applen ilmoittamat muutokset asettavat lapset ja muut käyttäjät vaaraan sekä nyt että tulevaisuudessa. Kehotamme Applea luopumaan näistä muutoksista ja vahvistamaan yrityksen sitoutumisen suojella käyttäjiään päästä päähän -salauksella. Kehotamme myös Applea neuvottelemaan säännöllisemmin kansalaisyhteiskunnan ryhmien ja haavoittuvien yhteisöjen kanssa, joihin sen tuotteiden ja palveluiden muutokset voivat vaikuttaa suhteettomasti.

Viestejä

Apple esittelee tämän uuden ominaisuuden macOS Montereyn, iOS 15: n ja iPadOS 15: n julkaisun myötä, toiminto, johon liittyy järjestelmä, joka havaitsee lasten seksuaalisen materiaalin levittämisen Viestit -sovelluksen kautta ja joka ilmoittaa vanhemmalle tai huoltajalle, jos alaikäinen on saanut seksuaalisesti implisiittisiä kuvia.

Nämä kuvat näyttävät aluksi epäselviltä, ja alaikäiselle (jos he ovat 12 -vuotiaita tai nuorempia) selitetään viestin kautta, että kuva ei ole heille sopiva. Jos päätät katsoa sitä, vanhemmat saavat ilmoituksen kuvan kanssa. Tässä mielessä olisi suositeltavampaa vanhemmat antoivat alaikäiselle mahdollisuuden päästä kuvaan.

Viestit -sovelluksen kautta vastaanotetut kuvat, skannataan laitteella ja se tieto ei tule sieltä. Viranomaiset tai Apple eivät saa tietoa tapahtumasta.

Siri

Siri on myös osallistunut lapsipornografian torjuntaan. IOS 15: n, iPadOS 15: n ja macOS Monterreyn julkaisun myötä, jos käyttäjä etsii tällaista sisältöä, saat ilmoituksen, jossa kerrotaan, että etsit laitonta materiaalia ja se ilmoittaa sinulle, mistä saat apua ja keinot ilmoittaa tällaisesta sisällöstä.

Tämä prosessi, kuten Viestit -sovelluksen kautta vastaanotettujen kuvien analysointi, suoritetaan laitteen sisäisesti, ilman Applen tai viranomaisten tietämystä.