С тех пор, как Apple объявила обнаружение материалов сексуального насилия над детьми для iOS, iPadOS и macOS Ранее в этом месяце было много споров. Не только среди экспертов по безопасности, но даже среди собственных сотрудников Apple, которые просили Apple не внедрять его.

Последними, кто присоединился к недомоганию по поводу внедрения этой системы, более чем 90 групп гражданских прав. Они написали в Apple открытое письмо с просьбой отказаться от своих планов CSAM (материалы о сексуальном насилии над детьми). Причина, по которой они намекают, заключается в том, что эту систему можно использовать для других целей.

Что такое CSAM?

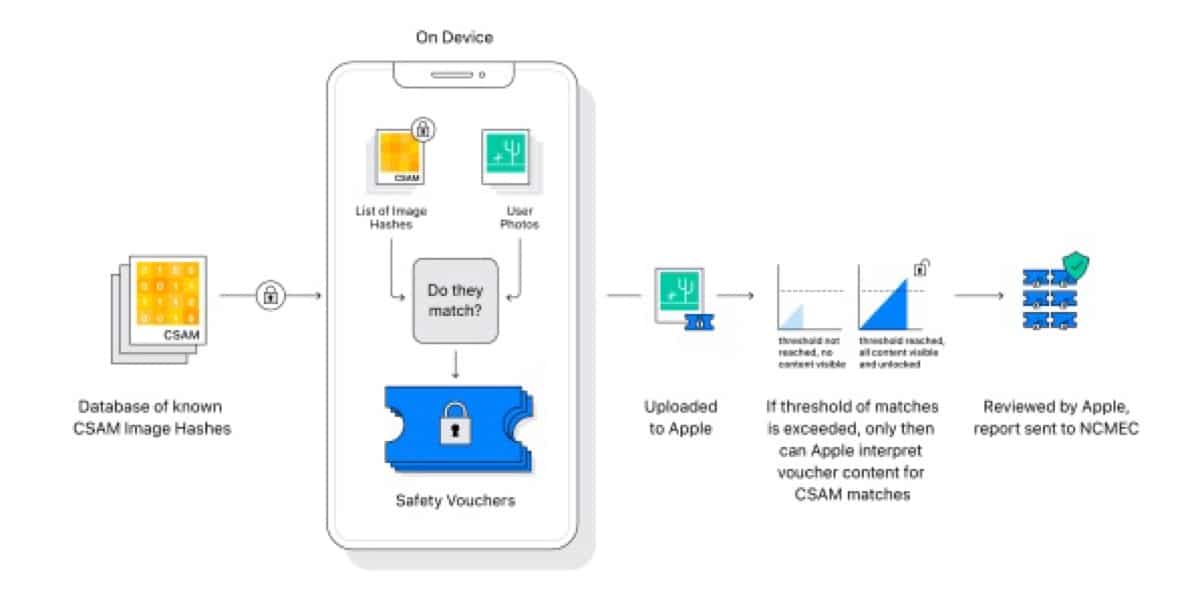

CSAM, что в переводе означает «Материалы о сексуальном насилии над детьми», каталог фотографий с содержанием детской порнографии, известных, подготовленных и обновленных периодически различными ассоциациями, содержание которых контролируется Национальным центром пропавших без вести и эксплуатируемых детей (NCMEC).

Каждая фотография, хранящаяся в этой базе данных, имеет уникальную цифровую подпись, цифровую подпись, которая он будет сравниваться с изображениями фотографий, хранящихся в учетных записях пользователей iCloud. Если совпадение обнаружено, доступ к учетной записи пользователя будет заблокирован, и власти будут уведомлены.

Google, Dropbox и Microsoft уже некоторое время используют эту систему отслеживания изображений для учетных записей пользователей, но Apple пошла еще дальше и создал новую систему под названием NeuralHash, систему, которая теоретически анализирует зашифрованное облако пользователя и ищет эти типы изображений, к которым даже сама Apple не имеет доступа.

Расстроен от организаций гражданских прав

Между некоторые из подписавших это письмо это Американский союз гражданских свобод, Канадская ассоциация гражданских свобод, австралийская организация Digital Rights Watch, British Liberty, Privacy International ...

Письмо начинается с выделения возможностей NeuralHash, в котором говорится, что:

Хотя возможности предназначены для защиты детей и сокращения распространения материалов о сексуальном насилии над детьми (CSAM), мы обеспокоены тем, что они используются для цензуры защищенных высказываний, угрожают неприкосновенности частной жизни и безопасности людей во всем мире и имеют катастрофические последствия для многих детей. .

Как только эта возможность будет включена в продукты Apple, компания и ее конкуренты столкнутся с огромным давлением - и, возможно, с юридическими требованиями - со стороны правительств по всему миру, чтобы сканировать фотографии не только для CSAM, но и других изображений, которые правительство считает сомнительными.

Эти изображения могут содержать нарушения прав человека, политические протесты, изображения, которые компании называют «террористическими» или насильственным экстремистским контентом, или даже нелестные изображения самих политиков, которые будут оказывать давление на компанию, чтобы они отсканировали их.

Эти 90 организаций утверждают, что поиск фотографий может быть расширен до изображений, хранящихся на устройствеа не только те, которые хранятся в iCloud, поэтому Apple, возможно, создала основу для цензуры, слежки и преследований во всем мире.

Само собой разумеется, что когда правительство призывает Apple предоставить доступ к контенту своих пользователей, таких как Китай или Россия, Apple склоняет голову и идет навстречу вашим требованиям. Кто уверяет нас, что Apple не будет придерживаться той же политики в отношении других стран?

Далее в письме говорится, что эта система подвергнет детей риску:

Система, разработанная Apple, предполагает, что задействованные «родительский» и «дочерний» учетные записи на самом деле принадлежат взрослому, который является родителем ребенка, и что эти люди поддерживают здоровые отношения.

Это не всегда так; оскорбительный взрослый может быть организатором учетной записи, и последствия уведомления родителей могут угрожать безопасности и благополучию ребенка. ЛГБТК + молодежь в семейных аккаунтах с неблагожелательными родителями особенно подвержена риску

В конце письма говорится, что, несмотря на усилия Apple по сокращению жестокого обращения с детьми, компания должен оставаться твердым в политике конфиденциальности что он построил в последние годы.

Мы поддерживаем усилия по защите детей и решительно выступаем против распространения CSAM. Но изменения, о которых объявила Apple, подвергают опасности детей и других пользователей как сейчас, так и в будущем. Мы призываем Apple отказаться от этих изменений и подтвердить приверженность компании защите своих пользователей с помощью сквозного шифрования. Мы также призываем Apple более регулярно консультироваться с группами гражданского общества и уязвимыми сообществами, на которые могут непропорционально сильно повлиять изменения в ее продуктах и услугах.

Сообщения

Apple представит эту новую функцию с выпуском macOS Monterey, iOS 15 и iPadOS 15, функция, которая сопровождается системой, которая будет обнаруживать распространение детских сексуальных материалов через приложение «Сообщения» и уведомлять родителя или опекуна, если несовершеннолетний получил изображения, классифицируемые как неявные сексуального характера.

Сначала эти изображения будут выглядеть размытыми, и в сообщении несовершеннолетнему (если им 12 лет и младше) будет объяснено, что изображение им не подходит. Если вы решите просмотреть его, родители получат уведомление вместе с изображением. В этом смысле было бы целесообразнее, чтобы именно родители дали разрешение несовершеннолетнему на доступ к изображению.

Изображения, полученные через приложение Сообщения, будет сканироваться на устройстве и эта информация не появится оттуда. Ни власти, ни Apple не будут знать об этом событии.

Siri

Siri также присоединилась к борьбе с детской порнографией. С выпуском iOS 15, iPadOS 15 и macOS Monterrey, если пользователь ищет этот тип контента, вы получите уведомление о том, что вы проводите поиск материала, который считается незаконным и он проинформирует вас о том, где вы можете найти помощь и о способах сообщить о таком содержании.

Этот процесс, как и анализ изображений, полученных через приложение «Сообщения», будет выполняться внутри устройства. без ведома Apple или властей.