Sedan Apple tillkännagav upptäckt av material för sexuella övergrepp mot barn för iOS, iPadOS och macOS Tidigare denna månad var det mycket debatt. Inte bara bland säkerhetsexperter, utan även bland Apples egna anställda som har bett Apple att inte implementera det.

De sista att ansluta sig till obehaget över implementeringen av detta system är mer än 90 medborgerliga grupper. De har skrivit ett öppet brev till Apple och bett det att gå tillbaka till sina CSAM -planer (material för sexuellt övergrepp mot barn). Anledningen till att de anspelar är att detta system kan utnyttjas för andra ändamål.

Vad är CSAM?

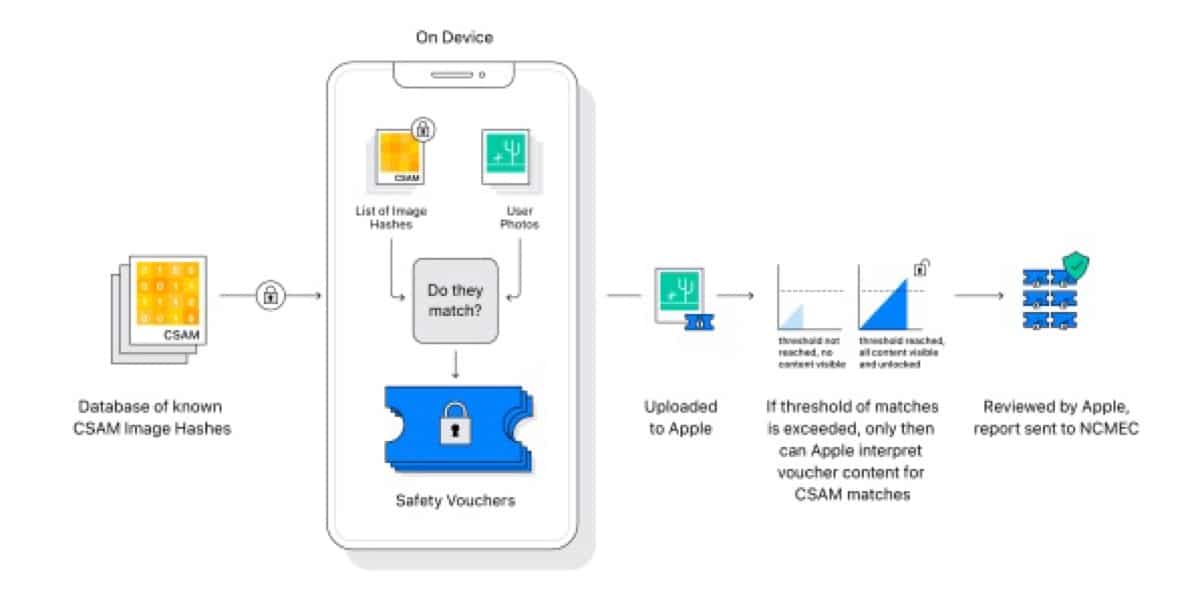

CSAM, översatt som material för sexuellt övergrepp mot barn, är en katalog över fotografier med innehåll från barnpornografi, känd, utarbetad och uppdaterad regelbundet av olika föreningar och vars innehåll kontrolleras av National Center for Missing and Exploited Children (NCMEC).

Var och en av fotografierna som lagras i denna databas har en unik digital signatur, en digital signatur som det kommer att jämföras med bilderna på bilderna som lagras i iCloud -användarkontona. Om en matchning upptäcks blockeras åtkomst till användarens konto och myndigheterna meddelas.

Google, Dropbox och Microsoft har använt detta bildspårningssystem för användarkonton under en tid, men Apple har gått ett steg längre och har skapat ett nytt system som heter NeuralHash, ett system som analyserar användarens krypterade moln, i teorin, på jakt efter den här typen av bilder och som inte ens Apple själv har tillgång till.

Upprörd från medborgerliga rättighetsorganisationer

Mellan några av undertecknarna av detta brev det finns American Civil Liberties Union, Canadian Civil Liberties Association, den australiensiska organisationen Digital Rights Watch, den brittiska organisationen Liberty, Privacy International ...

Brevet börjar med att markera funktionerna hos NeuralHash och säger att:

Även om förmågor är avsedda att skydda barn och minska spridningen av material för sexuellt övergrepp mot barn (CSAM), är vi oroade över att det används för att censurera skyddat uttryck, hota integriteten och säkerheten för människor runt om i världen och få katastrofala konsekvenser för många barn .

När den här förmågan har införlivats i Apples produkter kommer företaget och dess konkurrenter att möta enormt tryck - och potentiellt lagliga krav - från regeringar runt om i världen för att skanna foton efter inte bara CSAM, utan också av andra bilder som en regering anser tvivelaktiga.

Dessa bilder kan vara av kränkningar av de mänskliga rättigheterna, politiska protester, bilder som företag har betecknat som "terrorist" eller våldsamt extremistiskt innehåll, eller till och med smickrande bilder av politikerna själva som kommer att pressa företaget att skanna dem.

Dessa 90 organisationer hävdar att sökandet efter fotografier kan utvidgas till bilder som lagras på enheten, inte bara de som lagras i iCloud, så Apple kan ha skapat grunden för censur, övervakning och förföljelse över hela världen.

Det säger sig självt att när en regering uppmanar Apple att ge åtkomst till innehållet i sina användare, till exempel Kina eller Ryssland, Apple böjer huvudet och uppfyller hans krav. Vem försäkrar oss om att Apple inte kommer att följa samma policy med andra länder?

I brevet står det vidare att detta system kommer att utsätta barn för fara:

Systemet som Apple har utvecklat förutsätter att de berörda "föräldrarna" och "barn" -kontona faktiskt tillhör en vuxen som är förälder till ett barn och att dessa individer har ett hälsosamt förhållande.

Detta är inte alltid fallet; en kränkande vuxen kan vara kontoorganisatören, och konsekvenserna av att meddela föräldrar kan hota barnets säkerhet och välbefinnande. HBTQ + ungdomar i familjekonton med osympatiska föräldrar är särskilt utsatta

Brevet slutar med att det står att trots Apples ansträngningar att minska övergrepp mot barn, företaget måste vara fast i sekretesspolicyn som han har byggt de senaste åren.

Vi stöder ansträngningar för att skydda barn och motsätter oss starkt spridningen av CSAM. Men de förändringar som Apple har meddelat utsätter barn och andra användare för fara, både nu och i framtiden. Vi uppmanar Apple att överge dessa ändringar och bekräfta företagets engagemang för att skydda sina användare med end-to-end-kryptering. Vi uppmanar också Apple att regelbundet samråda med civilsamhällets grupper och utsatta samhällen som kan påverkas oproportionerligt mycket av förändringar av sina produkter och tjänster.

Inlägg

Apple kommer att introducera denna nya funktion med lanseringen av macOS Monterey, iOS 15 och iPadOS 15, en funktion som åtföljs av ett system som kommer att upptäcka spridning av sexuellt material från barn genom appen Meddelanden och som kommer att meddela föräldern eller vårdnadshavaren om den minderårige har fått bilder som klassificerats som sexuellt underförstådda.

Dessa bilder kommer inledningsvis att vara suddiga och genom ett meddelande kommer det att förklaras för den minderårige (om de är 12 år eller yngre) att bilden inte är lämplig för dem. Om du bestämmer dig för att se den får föräldrarna ett meddelande tillsammans med bilden. I den meningen skulle det vara mer lämpligt att det var föräldrarna som gav klartecken för den minderårige att få tillgång till bilden.

Bilder som tagits emot via appen Meddelanden, kommer att skannas på enheten och den informationen kommer inte ut därifrån. Varken myndigheterna eller Apple kommer att ha kunskap om händelsen.

Siri

Siri har också gått med i kampen mot barnpornografi. Med lanseringen av iOS 15, iPadOS 15 och macOS Monterrey, om en användare söker efter den här typen av innehåll, du får ett meddelande som informerar dig om att du söker efter material som anses vara olagligt och det kommer att informera dig om var du kan hitta hjälp och hur du kan rapportera sådant innehåll.

Denna process, liksom analysen av bilder som tas emot via appen Meddelanden, kommer att utföras internt på enheten, utan medvetenhet från Apple eller myndigheterna.